I våres lanserte SAS Institute en produktserie kalt Visual Analytics: en «i minne» («in memory») plattform for datautforskning.

– Plattformen omfatter ikke bare en i minne-database men også en i minne-analysemotor, presiserer Henrik Slettene som har ansvaret for produktserien i SAS Institute i Norge.

Prinsippet for i minne-analyse er å filtrere store datasett lagret i minne. Dataene samles i én stor tabell. Er de opphavelig fordelt på ulike tabeller i relaterte databaser, slås tabellene sammen.

Hastighetsgevinsten ved å holde data i minne og filtrere dem der, er enorm. Det viktigste med dette er at arbeidet med å samle data med tanke på analyse kan kortes kraftig ned. Dermed kan man bruke desto mer tid på selve analysen.

– Analytikere i dag bruker 80 prosent av tiden sin på å tilrettelegge data. Det er ikke hensiktsmessig. De skulle heller sett på betydningen av flere titalls variabler og samspillet mellom dem. Nå har de bare tid til en håndfull variabler. Med den tradisjonelle måten å drive analyse på kan man utløse IT-jobber som varer i timer. I minne-tilnærmingen snur dette opp ned. Man utfører tidligere timelange jobber på sekunder. Man kan spørre igjen og igjen: Analysen får en helt annen treffsikkerhet. Analytikere får endelig tid til virkelig å analysere, og det er mulig å fatte beslutninger på ordentlig data.

Slettene mener dette vil medføre nye samarbeidsmetoder i bedrifters beslutningsprosesser.

– Flere kan sitte sammen og vurdere ulike måter å gjøre ting på. Man kan kjøre ulike scenarier, og finne fram til det som ser ut til å bli det mest hensiktsmessige. Det kan gjøres med samhandling innen en ledergruppe. Det er en radikal endring i måte å arbeide på.

Opplevelsen av å «drukne i data» skyldes at analyseprosessen ikke holder tritt med dataveksten, ifølge Slettene.

– Det er ikke noe nytt i at vi snakker om at vi har for mye data og at det vi trenger er informasjon. Men presset blir større. Vi er inne i en utvikling der syklusene i forretningslivet går fortere. Informasjon er makt i kortere tid om gangen. Tiden man kan skaffe seg en fordel blir kortere. Det bidrar til at tradisjonelle datavarehusmiljøer drukner i jobb, fordi de får krav om å levere rapporter og analyser i stadig større tempo. Men det greier de ikke å levere på eksisterende teknologi.

Slettene legger til at det egentlig ikke handler om «big data» men om data generelt.

– Om du drukner på to meters dyp eller på tu hundre meters dyp, blir virkningen den samme.

Norske bedrifter anerkjennes internasjonalt for effektiv bruk av IT. Slettene mener analyse er et unntak.

– Vår erfaring er at dette ikke stemmer når det kommer til forretningsanalyse og beslutningsstøtte. Vi ser at norske selskaper merker konkurranse fra utenlandske som er bedre enn dem. På dette feltet er ikke norske selskaper lengst framme. Og her vil konkurransen skjerpes.

SAS-mannen mener bedrifter må skaffe seg rom til å være med på innovasjonsprosesser, og bruke teknologien til å arbeide på nye måter.

– Det sitter langt inne. Det er få som har dette perspektivet. I beste fall legger man opp en IT-strategi som tar hensyn til forretningsstrategien. Poenget med IT-strategien burde heller være å fornye forretningen.

Fokuset på i minne-teknologi i forretningsanalyse og beslutningsstøtte gjenspeiler flere aktuelle trender innen IT, i tillegg til presset om å levere stadig mer innsikt i hva som egentlig skjer. Slettene nevner moderne maskinvare og moderne grensesnitt med vekt på berøring og grafikk.

– Mange av konseptene bak i minne-teknologi kan føres tilbake til 1990-tallet, for eksempel HPC [high performance computing] og kolonnebaserte databaser. Det nye er at maskinvare med kraftige prosessorer og rimelig tilgang til mye minne gjør i minne-tilnærmingen tilgjengelig for langt flere.

Slettene advarer mot å knytte i minne-teknologi tett opp mot det svært så trendye «Big Data».

– «Big Data»: Hvem gjelder det? Mange har ikke så fryktelig mye data. Vi erfarer at svært mange virksomheter har mer enn nok av utfordringer rundt small data. Poenget er at man nå kan gå nye veier, dersom man virkelig mener at informasjon er en strategisk ressurs.

Markedskampanjer er en typisk kandidat for i minne-løsninger.

– Det sentrale spørsmålet er: Hvilke kunder skal hvilke kampanjer rettes mot? Tidligere måtte man kjøre spørringer i store batch, og få resultatene om morgen. Med i minne, kan de samme kjøringene gjøres på sekunder. Man kan justere gjentatte ganger, og stadig øke treffsikkerheten.

SAS Institutes pakker for i minne-løsninger er såpass nye at de ikke ble nevnt da analyseselskapet Gartner gikk gjennom aktuelle leverandører på ITxpo-samlingen i Barcelona i november (se oversikten i artikkelen – Kan gjøre det utenkelige mulig). Hvordan er det de tenker?

– Vi mener at mange av de nye i minne-løsningene i praksis dreier seg om SQL i minne med tilhørende ressurskrav på admin-siden. Det vi tilbyr er derimot komplett, og det er fritt for SQL. Det dreier seg bare om filtrering på datasett. Det gir en helt annen fleksibilitet på å bygge hierarkier. Man slipper å lage predefinerte agggregeringer for å gjøre det lettere å spørre. I minne-teknologien lar brukeren gjøre dette «on the fly». Du slipper å bygge de kompliserte modellene. I stedet går du rett på datasett med for eksempel 20 000 kolonner og tre milliarder rader. Ting går unna på få sekunder.

En typisk konfigurasjon for dette på det norske markedet, ifølge Slettene, er en fire blade-server.

– Det passer for alt fra avdelinger og oppover til store løsninger. Man skalerer ved å legge til flere blades. Teknologien er helt standard: Jboss, Linux, Hadoop, ting som IT-avdelingene har og elsker, eventuelt også Teradata eller Greenplum. Det er stor interesse for Hadoop i Norge.

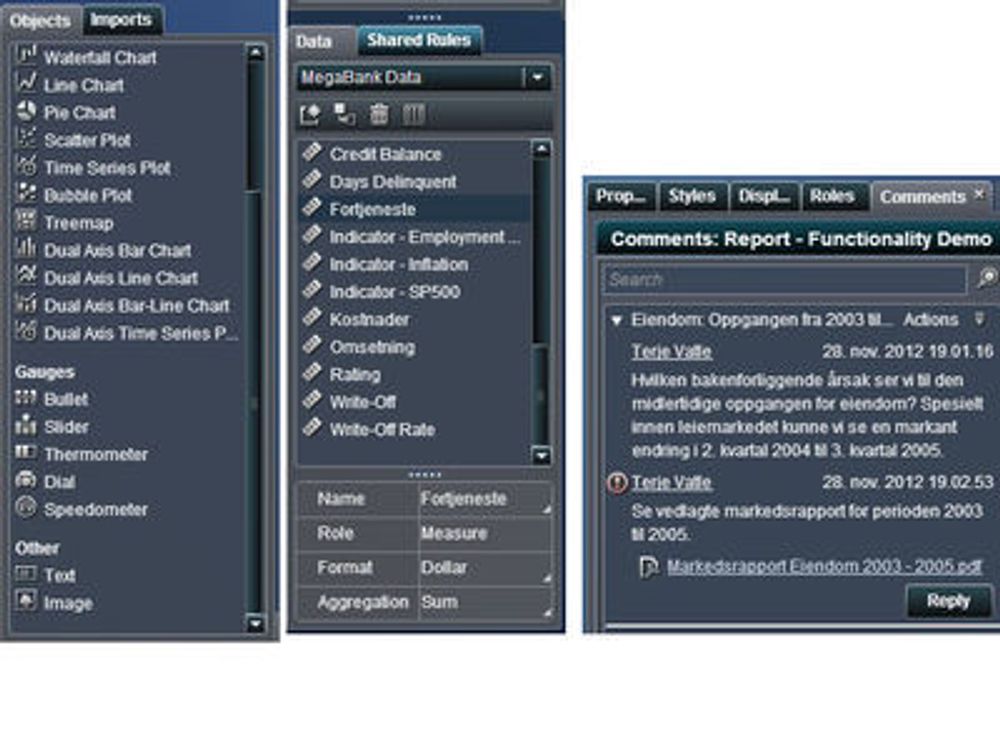

Så er det klart for en demonstrasjon av SAS Visual Analytics. Slettene velger et datasett med 46 kolonner og 1,1 milliarder rader. Demonstrasjonen kjøres på henholdsvis en bærbar pc og en iPad, og kjøres på en server på den andre siden av Atlanterhavet. Slettene leker seg med noen grunnleggende variabler, legger opp filtre og viser tabeller, krysstabeller og grafikk.

Arbeidet på nettbrettet er spesielt fascinerende: Berøringsgrensesnittet kommer til sin rett. Det er ikke bare tilpasset mobile enheter: SAS tror på samhandling foran store skjermer med berøringsgrensesnitt der flere analytikere kan utforske ideer og muligheter i fellesskap.

– Hensikten med analyse er å finne ut hva som påvirker hva og hvordan ting henger sammen. Da må man stille mange spørsmål rett etter hverandre, og få fortløpende svar raskt.

Slettene viser hvordan man kan grave i helsedata, på jakt etter diagnoser som ofte opptrer samtidig. Det er viktig viten for leger, men har vært vanskelig å finne ut av slik IT-systemer har vært konstruert hittil. I Visual Analytics Explorer lages korrelasjonsanalyse på mange data nærmest øyeblikkelig.

Løsningen omfatter geodata og og kart. Samtidig lar deg brukeren bygge hierarkier på impuls, uten å ty til IT. Slettene viser hvordan dette kan brukes til å drille raskt ned fra region til for eksempel fylke og deretter by.

– Lite involvering av IT-avdelingen er noe av essensen i det vi gjør. Trass i navnet, er det ikke bare et visualiseringsverktøy. Det tar også alt det bakenforliggende med dataforvaltning («governance») og så videre.

Til slutt understreker Slettene at det ikke er slik at man ikke trenger datavarehus lenger.

– Vi trenger fortsatt datavarehus, men poenget er at vi må videre. Det viktigste er å klargjøre hvilket formål dataene skal tjene.