Europeiske og norske representanter for Hitachi Data Systems (HDS) presenterte selskapets nye flaggskip innen lagring, «Virtual Storage Platform» (VSP) for norske journalister i forrige uke, noen dager etter den storstilte internasjonale lanseringen. Hitachi-folkene var tydelig stolte over det nye produktet, som de mener utgjør en teknologi som kan føre drift, kapasitet og effektivitet i moderne datasentraler til et nytt nivå.

For ordens skyld: HDS er det Hitachi-selskapet som leverer ferdige lagringssystemer. Hitachi-selskapet som lager disker, og som i sin tid kjøpte diskproduksjonen til IBM, er Hitachi Global Storage Technologies. HDS ble etablert i 1989, og teller 4200 ansatte som alle er vendt mot kundene. Forskning og utvikling foregår i andre Hitachi-selskaper, presiserer Michael Väth som leder HDSs virksomhet i Europa.

Mange HDS-installasjoner er levert gjennom OEM-avtaler, først og fremst Sun og HP. Avtalen med Sun er slutt. Väthe tror forholdet til HP vil fortsette, selv om HP har brukt store ressurser på å kjøpe 3Par for å skaffe et eget fotfeste innen avansert bedriftslagring.

HDSs syn på utviklingen innen bedrifters bruk av datateknologi gjenspeiler typiske oppfatninger i tiden. Behovet for lagring synes umettelig, og framtiden krever løsninger som er virtualiserte, automatiserte og beredt på nettskyen. Miljøhensyn krever at de samtidig er bærekraftige.

Den nye VSP erstatter Hitachis tidligere modeller. Med et stikk til EMC – uten å nevne navn – tillater Väthe seg å bemerke at i lagring «trenger man én plattform for all data, ikke ett produkt for hvert problem.» Det innebærer at forventningene til VSP er skyhøye, selv om det understrekes at målgruppen ikke akkurat har noe til felles med det såkalte SMB-markedet. VSP er stort, og henvender seg til de store.

I praksis dreier det seg om to lanseringer. Rackene som utgjør selve VSP er det synlige. I tillegg kommer «Command Suite», driftssystemet som sørger for innsyn i blokker, disker, sider og logiske volumer, for effektiv lagdeling, deduplisering og arkivering, og som skal realisere Hitachis løfte om en ny løsning som kan integrere alt man har av øvrige lagringsprodukter – også fra andre leverandører – og gjøre datasentraler om til «pålitelige, åpne og dynamiske informasjonssentraler».

Teknisk markedsdirektør Bob Plumridge tar på seg å forklare et uttrykk som preger markedsføringen av VSP: «3D-skalering». Det betyr i korte trekk at man i hver rack kan «skalere oppover» ved å legge til disker og andre komponenter. Så kan man samle flere rack i noe driftsprogramvaren oppfatter som bare en utvidelse av den samme enheten. Det er å «skalere utover». Til slutt kan man også «skalere dypt», ved å knytte systemet til det som måtte være hensiktsmessig av ekstern lagring, også enheter levert av andre leverandører. Til sammen kan VSP håndtere en kapasitet på 247 petabyte.

Skaleringen oppover omfatter alle komponenter som inngår i en rack. Systemprogramvaren kjører på Intel-drevne bladservere i egne systemmoduler (selvfølgelig på Hitachis eget lagringsorienterte operativsystem). Lagringsmoduler leveres i tre varianter: 2,5 tommers disker som snurrer i 15 000 omdreininger per minutt, klassiske 3,5 tommers disker for rimelig kapasitet på laveste lagringsnivå, og flashdisker (SSD) på 200 eller 400 gigabyte.

Ifølge Plumridge er det foreløpig liten etterspørsel etter SSD-moduler, siden de koster ti ganger så mye per terabyte som de raskeste og dyreste diskene.

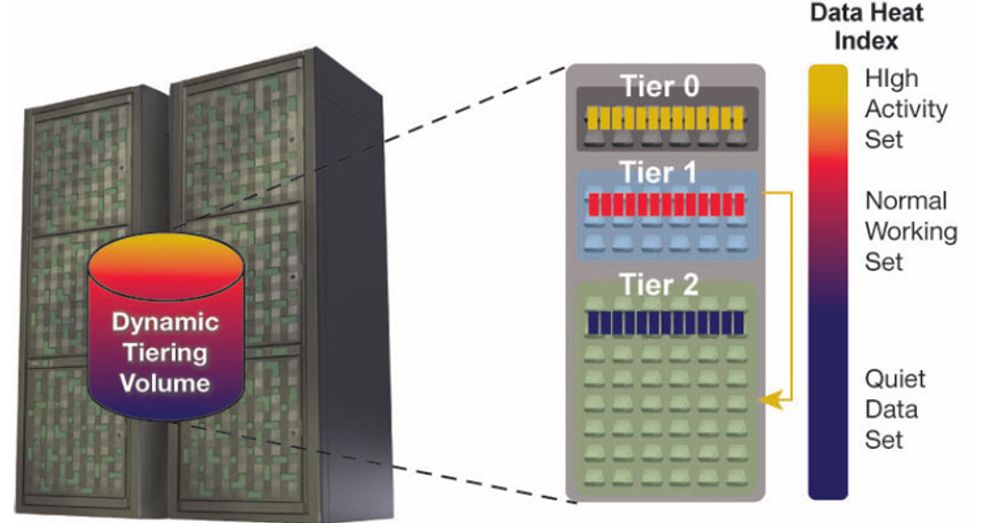

Med VSP har Hitachi innført et nytt prinsipp for å løse noe alle lagringsleverandører liker å tilby: lagdelt lagring. Lagdelt lagring vil grovt sett si at hyppig etterspurt data lagres på de raskeste diskene, mens data som brukes sjelden lagres på de rimeligste og tregeste. Utfordringen med dette er å sortere data slik at alt plasseres i riktig lag.

Løsningen som Hitachi har valgt for VSP går ut på å legge sorteringen ned i selve systemvaren for lagringen, framfor å prøve å finne ut hvor filer eller logiske volumer burde plasseres for å oppnå maksimal utnyttelse av lagringsressursene. Plumridge forklarer dette slik:

– All fysisk lagringskapasitet deles i sider («pages») på 42 megabyte. Mens systemet er i vanlig drift, overvåkes trafikken inn og ut av hver side. Etter en hensiktsmessig valgt overvåkingsperiode, kjøres en prosess der hver side plasseres der det hører hjemme, ut fra måten den er brukt på. Hyppig etterspurte sider på en SATA-disk flyttes for eksempel oppover. Overvåkingsprosessen tar typisk en time: Den påvirker ikke ytelsen i systemet. Overvåkingen kan forlenges helt opp til sju dager, hvis man anser at det skulle være nødvendig.

Erfaringen fra utprøvingen av VSP i produksjonsmiljøer tilsier at det for noen kan være hensiktsmessig å kjøre en overvåking på en time annenhver eller tredje hver dag. I andre miljøer er andre intervaller for overvåking og flytting mer hensiktsmessig.

– Det som er poenget, er at både overvåking og flytting kjøres under drift, og at det skjer uavhengig av hva slags data det dreier seg om. Det kan tilhøre en applikasjon, eller en database. Det bryr ikke denne sideorienterte dynamiske lagdelingen [«page based dynamic tiering»] seg om.

Det er avgjørende for brukernes opplevelse av ytelsen i systemet at data plasseres riktig. Plumridge forteller om en norsk pilotkunde som undersøkte dette nøye, og som fant at ytelse og kapasitet kunne økes uten merkostnader ved å kutte ut alle raske disker, og i stedet operere med en blanding av SSD og SATA-disker. Laget med SATA-disker kan for øvrige være helt eller delvis ekstern, slik VSP-arkitekturen er bygget opp.

Hitachi har arbeidet med lagringsvirtualisering i mange år, faktisk siden 1990-tallet. I mars 2000 ble digi.no invitert til en demonstrasjon av en installasjon i Frösunda utenfor Stockholm der HDS og Veritas Software (i dag en del av Symantec) hadde bygget opp et lagringsnett på 17 terabyte med garantert oppetid, som var konstruert slik at hver av mange hundre servere fikk tildelt logiske, altså virtuelle, lagringsressurser etter behov. Se denne reportasjen: Lagringsnett på 17 terabyte med garantert oppetid.