Forskere hos Google har utviklet et system som ved hjelp av maskinlæring kan lage korte beskrivelser av hva som vises på et bilde, slik som beskrivelsen som er gjengitt under toppbildet i saken og under bildene lenger ned i saken. Systemet kalles for Neural Image Caption (NIC) Generator. Det omtales i denne forskningsrapporten.

Datamaskiner har lenge kunnet gjenkjenne enkeltobjekter i bilder, for eksempel et ansikt eller en katt. Men det er langt vanskeligere for datamaskinene å lage en kortfattet oppsummering av det som kan være en ganske komplisert scene. Da kreves det en dypere representasjon av det som foregår, å forstå hvordan de ulike objektene er relatert til hverandre, samt å oversette det hele til et naturlig språk.

De fleste mennesker kan gjøre dette helt uten videre. Men for synshemmede er bilder ofte til liten nytte, selv om de kan være helt vesentlige for seende. Det er langt fra alltid at bilder ledsages av en forklarende bildetekst.

Men det er ikke bare synshemmede som vil kunne ta i bruk slik teknologi når den etter hvert blir videreutviklet og moden. Det er allerede nå mulig å se for seg flere andre bruksområder.

Det mest selvfølgelige bruksområdet Google er å bruk NIC-generatoren i forbindelse med bildesøket. Dersom noen søker etter et bilde av «en flokk med elefanter som går over en tørr gresslette», så vil søkemotoren kunne finne fram til slike bilder basert på beskriver som NIC-generatoren har lagt i Googles metadata for bilder med nettopp slike motiver. Men foreløpig er dette mer teori enn praksis.

Man kan også tenke seg at teknologien på lenger sikt kan brukes til mer avansert bildeanalyse, for eksempel hos en etterretningsorganisasjon som teller stridsvogner i satellittbilder. Det kan også brukes til å få en tekstbasert beskrivelse av samtlige bilder i fotosamlingen til virksomheter og privatpersoner, slik man kan søke på den samme måten som i de webbaserte søketjenesten.

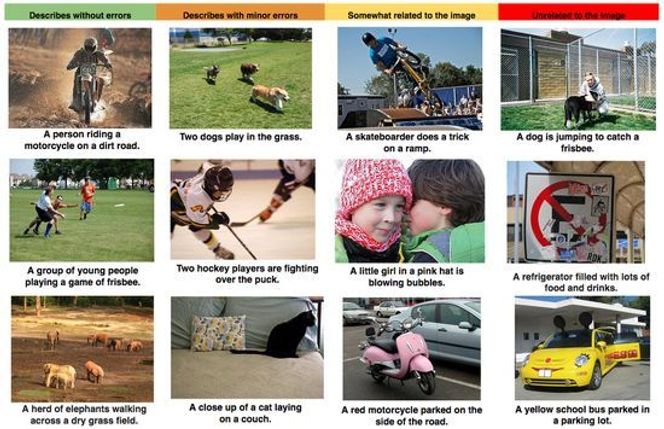

Eksperimentene til forskerne viste at NIC-generatoren stort sett var i stand til å generere fornuftige setninger. Men som bildet under viser, er det fortsatt en del å gå på når det gjelder tolkningen av innholdet.

Google har jobbet noen år med bildegjenkjenning og ulike områder innen kunstig intelligens. Blant annet bruker selskapet slike teknikker til å gjenkjenne husnummer i Street View-bildene, noe som man i blant kan se resultatene av i selskapets Recaptcha-tjeneste.

I bildesøket til Google har det en god stund vært mulig å laste opp bilder eller peke til bilder på andre nettsteder, for så å få søketjenesten til å finne bilder som ligner. Det samme er mulig i mobilappen Google Goggles. Ansiktsgjenkjennelse i verktøy som Picasa er selvfølgelig gammelt nytt.

Google er på ingen måte de eneste selskapet som bruker og videreutvikler bildegjenkjenning og annen kunstig intelligens. Både Facebook og kinesiske Baidu investerer tungt i dette området. Det langt mindre kjente selskapet Viblio tilbyr på sin side automatisk tagging av videoopptak.

Les også:

- [30.01.2015] Bill Gates uroet over kunstig intelligens

- [19.01.2015] Åpner opp verktøy for maskinlæring

- [12.01.2015] – Vær varsom med kunstig intelligens

- [26.11.2014] Foreslår ny test for kunstig intelligens

- [28.10.2009] Lover forbedret søk med bildegjenkjenning

- [29.04.2008] Google forsker på langt bedre bildesøk