Taleassistenter som hele tiden lytter og utfører ulike oppgaver basert på det vi sier kan være praktisk – men ikke helt uten sikkerhets- og personvernmessige utfordringer. Det har tidligere vært demonstrert hvordan taleassistenter på mobiltelefoner kan lures til å besøke ondsinnede nettsider, sende tekstmeldinger eller ringe bestemte telefonnummere ved å bruke kommandoer i ikke-hørbare frekvensområder.

Nå viser det seg også at det kan være mulig å lure taleassistenter med skjulte kommandoer i musikk eller i tale, ved å gjøre endringer i lydbølgene på en slik måte at mennesker hører noe helt annet enn det taleassistenten hører. Det skriver New York Times.

Allerede i 2016 viste en gruppe studenter ved University of California i Berkeley og Georgetown University at de kunne skjule kommandoer i «hvit støy» spilt over høyttalere, eller via Youtube-videoer, og på den måten få taleassistenter til å for eksempel åpne en nettside.

Nicholas Carlini er doktorgradsstudent i informasjonssikkerhet ved Berkeley-universitetet og sier til New York Times at de ønsket å se om de kunne klare å skjule talekommandoene enda bedre enn de gjorde i 2016.

Menneske og maskin hører samme setning forskjellig

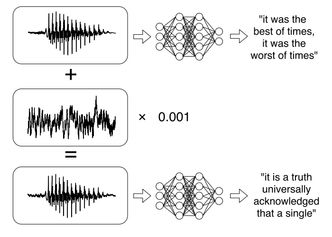

I en ny rapport viser forskere ved Berkeley hvordan kommandoer kan skjules i musikk eller tale på en slik måte at et menneske kan høre én bestemt setning, mens taleassistenten transkriberer dette til en helt annen setning – for eksempel som instruksjoner om å kjøpe inn bestemte varer eller åpne en nettside.

Det hele fungerer ved at man modifiserer lydfilene slik at man ifølge forskerne «nuller ut lyden som talegjenkjenningssystemet var ment å skulle høre, og erstatter det med en lyd som vil bli transkribert annerledes av maskiner, og nesten ikke være mulig å oppdage for det menneskelige øre».

I et eksempel viser forskerne to lydfiler som begge for det menneskelige øre høres omtrent like ut. Men en taleassistent vil oversette de to lydfilene til to ulike setninger.

Carlini vet ikke om teknikkene for å lure og manipulere Alexa og andre taleassistenter brukes av noen med onde hensikter.

– Men jeg antar at mennesker med onde hensikter allerede ansetter folk til å gjøre det som jeg gjør, sier han.

Du kan lese hele rapporten her.