Google kom i går med et sett med prinsipielle retningslinjer for selskapets bruk av kunstig intelligens. Dette skjer i kjølvannet av selskapets deltakelse i Project Maven, et militært forskningsprogram i USA hvor det utvikles en overvåkningsmotor for droner basert på kunstig intelligens.

Googles deltakelse førte først til protester blant mange av selskapets ansatte. Enkelte valgte etter hvert å si opp. Resultatet ble at Google valgte å ikke forlenge kontrakten med Pentagon. Den utløper riktignok først i mars 2019.

Skal brukes aktivt

Google-sjef Sundar Pichai nevner ikke Project Maven i et blogginnlegg om selskapets nye AI-prinsipper, men skriver at selskapet erkjenner at kraftig teknologi som dette resulterer i tilsvarende kraftfulle spørsmål angående bruken av teknologien.

Ifølge Pichai er de nye prinsippene ikke noe selskapet bare kommer med for syns skyld.

– De er konkrete standarder som aktivt vil styre forskningen og produktutviklingen vår, og de vil påvirke våre forretningsavgjørelser, skriver han.

I utgangspunktet består retningslinjene av sju prinsipper som Googles AI-baserte applikasjoner skal vurderes mot.

Blant annet skal det legges vekt på at de ikke skal skape eller forsterke urimelige fordommer, at de er skal ansvarlige overfor mennesker og at de er med bygget og testet i henhold til god praksis for sikkerhet og trygghet.

Våpen og menneskerettigheter

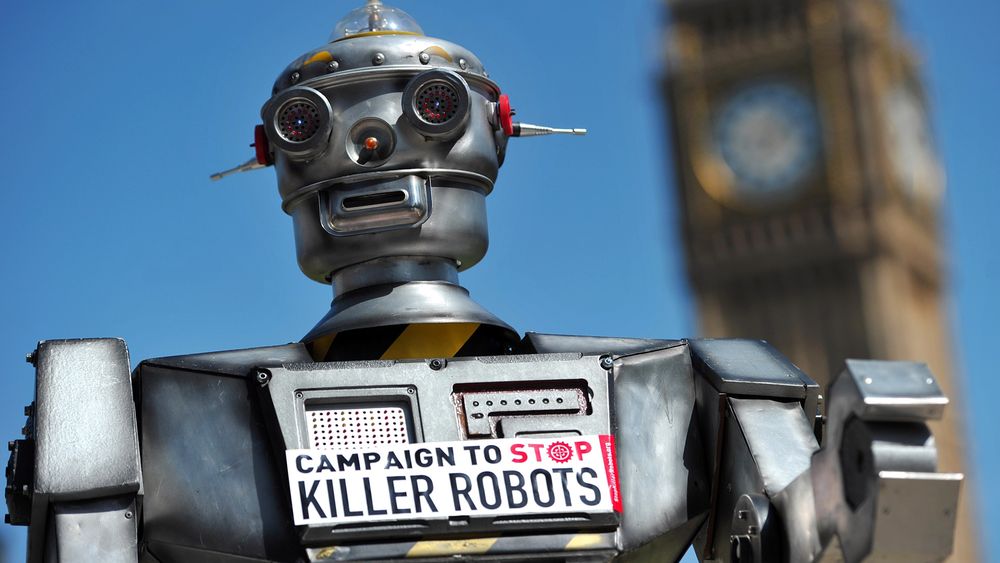

Men i tillegg til de sju prinsippene om hva Googles AI-applikasjoner skal være, har selskapet også kommet med fire punkter om hva selskapet ikke vil bruke kunstig intelligens til.

Generelt gjelder dette teknologier hvor nytteverdien ikke er langt større enn risikoen for å gjøre skade.

Mer konkret gjelder det våpen og andre teknologier hvor hovedhensikten er å påføre mennesker skade, teknologier for innsamling eller bruk av informasjon til overvåkning som med hensikt krenker internasjonalt aksepterte normer, samt teknologier som hvis formål strider mot allment aksepterte prinsipper i folkeretten og menneskerettighetene.

Dette betyr likevel ikke at ikke Googles AI-teknologier ikke kan bli brukt til uønskede formål. Mange av løsningene til selskapet er tilgjengelige for alle, og en god del er til og med utgitt som åpen kildekode.

Pichai understreker at selv om selskapet ikke vil utvikle kunstig intelligens for bruk i våpen, vil det fortsatt kunne samarbeide med myndigheter og militæret på mange andre områder, noe selskapet allerede gjør.