STOCKHOLM: Mediebransjen jakter fornyelse, og noen av de mest ettertraktede hodene akkurat nå, er utviklere som også forstår journalistikk. Eller journalister som er interessert i å lære seg enkel koding.

Med én fot i hvert av disse fagmiljøene, evner den nye generasjonen journalister å bearbeide enorme mengder data, finne nye sammenhenger, og presentere funnene på en måte som i større grad er relevant for individuelle mottakere.

I helgen samlet The Nordic Data Journalism Conference (NODA) 300 deltakere fra ledende mediehus i nord. Noen av disse, som YLE i Finland, SVT i Sverige og DR i Danmark, har allerede dedikerte datajournalistikkavdelinger med et tosifret antall ansatte, som produserer journalistikk etter nye standarder. Underveis i konferansen ble mange av deres mest spennende arbeider vist fram.

Her er noen av mulighetene utviklerkompetanse i redaksjonen gir:

1. Graving og etterforskning

Under NODA 2018 vant VG den mest prestisjetunge prisen, for "Investigative Journalism", med sine avsløringer rundt barneporno på den mørke weben. Med metoder som ennå ikke er offentliggjort (metoderapport leveres med SKUP-nomiasjon om noen uker) drev de regelrett en etterforskning. Først rundt hvem som lastet ned barneporno, deretter hvem som lastet opp. Gjennom elektroniske spor avslørte de at australsk politi drev verdens største overgrepsforum.

Dette er gravende datajournalistikk på aller høyeste nivå, og et eksempel som forklarer hvorfor for eksempel PST aktivt headhunter drevne datajournalister for tiden.

Men digital graving kan også gjøres enklere. Den største kneika er ofte å se mulighetene. tu.no fikk for eksempel en serie avslørende saker ut av å kjøre et script som koblet ansattlistene til Statens Vegvesen opp mot aksjonærregisteret, og på den måten dokumentere at enkelte ansatte kunne følge opp kontrakter til leverandører de hadde personlige eierinteresser i.

Denne typen koblinger av databaser gir helt nye svar, som vanskelig har latt seg finne gjennom manuelt arbeid. I tilfellet med Statens Vegvesen, skulle vi sammenligne opplysninger med mer enn 7000 ansatte med 1,7 millioner aksjonærer. Da trenger man hjelp av maskiner.

2. Overvåkning og varsler om avvik

Systematisk oppsett av datafeeder kan avdekke trender og periodiske svingninger som gir grunnlag for god journalistikk. I sin enkleste form kan det gjelde børskurser, eller omsetningssvingninger per bransje. Ved store avvik i positiv eller negativ retning kan det ligge grunnlag for nyhetssaker her.

Men tilnærmingen kan også hjelpe journalister med å fange opp andre typer nyhetssaker. I Teknisk Ukeblad Media har vi for eksempel utviklet et eget system som varsler oss hver gang et norsk teknologiselskap får berammet en rettssak. Dette er basert på offentlig tilgjengelige data, men systematisert på en måte som gir oss bedre oversikt.

Det finnes også mange åpne verktøy, som Google Alerts og Google Trends, som bidrar med varsler og data som kan eksporteres inn i andre systemer. Smart bruk av disse kan hjelpe en redaksjon med å vinne nyhetskampen mot konkurrenter.

3. Mengdeinformasjon

Antall journalister i Norge har sunket betraktelig de siste årene. Samtidig øker mengden av tilgjengelig informasjon. Dette åpner for ny arbeidsmetodikk i redaksjonene: Vi må se på hvordan vi kan berike våre sider med mer relevant innhold, som automatisk hentes inn, men som er redaksjonelt kurert.

Hvis våre lesere trenger en oversikt over konkurser og anbud, lager vi det, basert på åpne data og feeder, presentert på en måte som gjør det enkelt for hver leser å finne sin informasjon.

I Teknisk Ukeblad Media er dette et pågående arbeid som vi snart kan vise de første resultatene av, og i nær fremtid vil tu.no muligens ha mer innhold som er skapt av maskiner enn av mennesker. Automatiseringen er ment å tilføre sorterbar mengdeinformasjon, mens journalistene da får frigitt enda mer til å lage de dypere analysene, gravesakene og reportasjene.

Digi.no gjorde nylig en jobb i enkeltsak med noe av den samme logikken, der journalisten (som også har lært seg endel koding), presenterer en rangering over landets største og mest lønnsomme IT-bedrifter på en måte som lar brukeren selv sortere, filtrere og fordype seg i hva han synes er interessant.

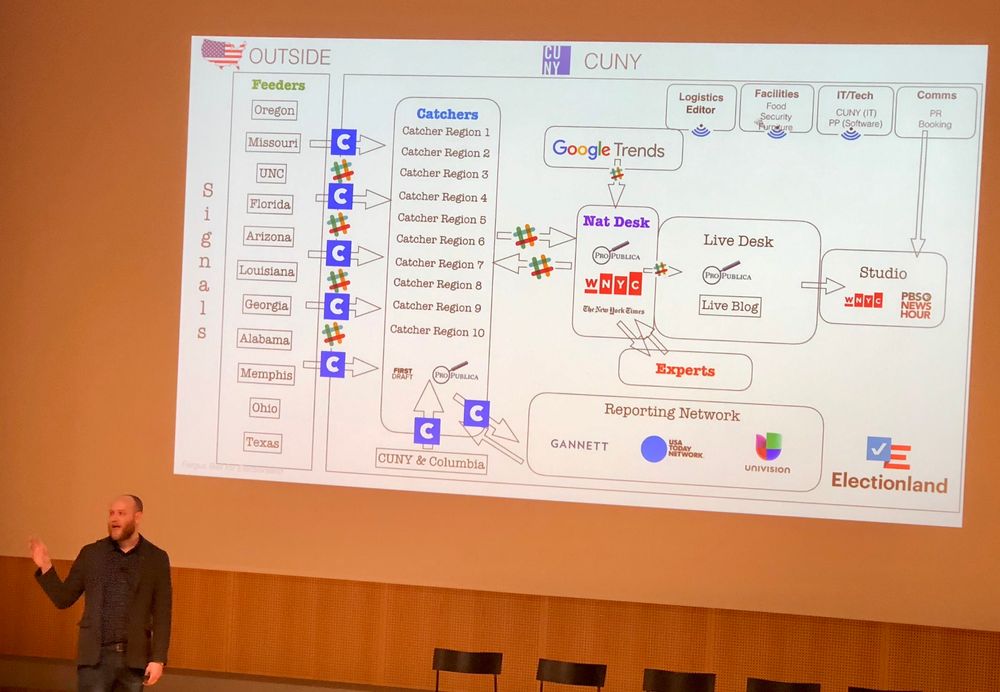

Under NODA 2018 demonstrerte Fergus Bell fra Electionland et imponerende opplegg bak tidenes største sosiale nyhetsformidling, bygget på det siste presidentvalget i USA. Ved å bruke et kobbel av utviklere, lokale redaksjoner, studenter og frivillige, klarte de å fortløpende å innhente og sortere informasjon om valglokaler som slet med logistikk eller teknologi for å avgi stemmer. De fikk varslet om avvik før det var for sent, og bidro til å øke valgdeltakelsen.

I fremtiden ønsker de å hente inn publikums videoer av hver tale kandidater gjør, transkribere dem og gjøre innholdet offentlig søkbart, slik at alle skulle kunne ettergå løfter og utsagn.

Her ser vi at bearbeiding av store informasjonsmengder kan bidra til å styrke demokratiet.

4. Robotjournalistikk

Robotjournalistikk er et naturlig neste steg. Når vi har hentet inn og sortert store mengder informasjon som er relevant for leserne, kan det i mange tilfeller være hensiktsmessig å få generert redaksjonelle artikler som oppsummerer dataene, type "Denne månedens konkurser i Vestfold".

Noen norske redaksjoner har kommet ganske langt med robotjournalistikk, blant annet NTB og VG rundt fotballdekning. Og Kommunal Rapport gjorde en spennende øvelse rundt forrige valg, hvor datajournalistikken bidro til å produsere et mye større antall saker enn journalister ville ha klart, brutt ned på lokale geografier.

Flere nyhetsbyråer jobber også med å bryte ned faktaorienterte saker i lokale versjoner, slik at de blir mer relevante for lokale publisister.

5. Skreddersøm

Vi er ferdige med one size fits all. Ulike lesere har ulike behov, og dette må reflekteres gjennom redaksjonell presentasjon.

Maskinlæring og kunstig intelligens er nøkler for å heve individuell relevans på sidene våre.

På tu.no og digi.no har brukerne lenge fått individuelle anbefalinger av artikler, basert på brukermønster som er registrert i cookies. Klikkraten på disse anbefalingene er betydelig høyere enn manuelle anbefalinger som samme plasser.

Men dette er bare en start: Digitalt abonnement medfører flere påloggede brukere, og en medfølgende mulighet til å gi brukerne mer selvstendig kontroll på hva de ønsker å få presentert, i hvilken form.

Også nyhetsbrev vil bli segmentert, basert på hvilken informasjon man er interessert i. Og AI-styrte bots vil kunne gjøre dialogen enda mer personlig.

- Google DNI Summit 2018: Nå snakker Google om AI først

6. Presis og pedagogisk presentasjon

En nettdesk må i 2018 må ta inn over seg hvordan sidene brukes. Vi ser tydelige svingninger gjennom døgnet, for eksempel på hvor lang tid leserne bruker på å konsumere en nyhetssak, og om de leser den på desktop eller telefon. "Presist innhold" er blitt et begrep innen publisering - gi leseren den informasjon hun trenger, tilpasset enheten hun er på og tiden hun har har til rådighet akkurat nå.

En vesentlig oppgave for utviklere i redaksjonene, er å utvikle presentasjonsformater som gir leserne mye informasjon på kort tid når de trenger det, og muligheten til å fordype seg når det er ønskelig. Bruk av interaktive grafer og andre rike formater blir mer utbredt, og noen er igang med ekspandere artikkelformater, der man først kan lese en kortversjon, for så å lagre dybdeversjonen til senere.

Nye fortellerteknikker kan også være mer funksjonelle til læring. Under NODA 2018 viste Danmarks Radio fram et spennende rigg om klimaendringer, bygget opp som en quiz, med spørsmål av typen "Hvor mye har vannstanden økt?", der leseren skriver inn sitt tips, får korrekt svar i en grafisk fremstilling, og en forklaring om bakgrunnen for endringen. Dette er en pedagogisk smart form for gameification.

7. Applikasjoner

Applikasjoner beriker nettsider og kan leve lenge. I sin enkleste form kommer disse som kalkulatorer, og i Teknisk Ukeblad Media utvikler vi for eksempel lønnskalkulatorer basert på ferske data om lønnsutvikling basert på stilling og ansiennitet.

Helsingen Sanomat viste under NODA 2018 fram en spennende sak, hvor brukeren svarer på en del spørsmål om egen livsstil, og får ut en grafisk fremstilling av hvor mye forurensing han påfører Østersjøen per år. Finske Alma Media har ellers laget en webapp som viser hva skatten din kan omsettes til, for eksempel i form av dagsverk for sykepleiere, og sammenligne din egen skatt med snittet eller landets rikeste.

Potensielt gir dette leserne nye perspektiver.

Generell nivåheving

Ved å jobbe systematisk med data, øker redaksjonens innsikt på mange områder, og kan bidra til en generell nivåheving også i enkle intervjusettinger. Ved å studere data i forkant av et intervju, stiller man med spissede spørsmål og egne vinklinger, og evner forhåpentlig å tilføre den offentlige debatten noe mer enn det som bare er formålstjenlig for kildene.

Journalistikken endres. Og redaksjonene trenger flere som kan kode. Vi trenger dem som kan tolke og sette sammen store datasett.

Under åpningstalen på NODA 2018, sa SVTs redaktør for datajournalistikk, Helena Bengtsson, det såpass bombastisk:

- Journalister som ikke vil utforske datajournalistikk, kommer til å bli akterutseilt.

Dette oppsummerer ganske greit hvorfor IT-kompetanse er noe av det viktigste for redaksjonene i tiden som kommer. Vi trenger to faggrupper som snakker sammen og utnytter hverandres spesialkompetanse.

Og jeg håper journalistutdanningene tar signalet.