Tidligere i år ble det kjent at den mektige Tesla-gründeren Elon Musk investerte millioner i organisasjonen Future of Life Institute (FLI), som er opptatt av å forske på påvirkningen av kunstig intelligens på menneskeheten.

Les mer: Donerer millioner for å unngå «Skynet».

Meningen er å blant annet undersøke om den stadig voksende utviklingen innen kunstig intelligens kan utgjøre en fare for verden slik den er i dag.

Nå snakker instituttet om hvordan pengene fra donasjonene vil utnyttes.

Disse får penger

FLI har nemlig publisert en liste over hvilke forskningsteam som vil få tildelt økonomisk støtte, og hvilke prosjekter de tar for seg. Det er 37 organisasjoner som får støtten, valgt fra over 300 som hadde søkt. Rundt syv millioner dollar skal fordeles mellom disse, og når de setter i gang med jobben i september, vil de være garantert støtte i tre år fremover.

De gjenværende fire millionene dollar vil distribueres senere.

De 37 organisasjonene har svært forskjellige innfallsvinkler på problematikken, fra sikkerhetsevaluering av maskinlæring og betydningen av kunstig intelligens i økonomien, via etiske retningslinjer i AI-forskning, til ganske abstrakte og filosofiske betraktninger rundt menneskelig kontroll av autonome våpensystemer.

Les også: Mann drept av robot.

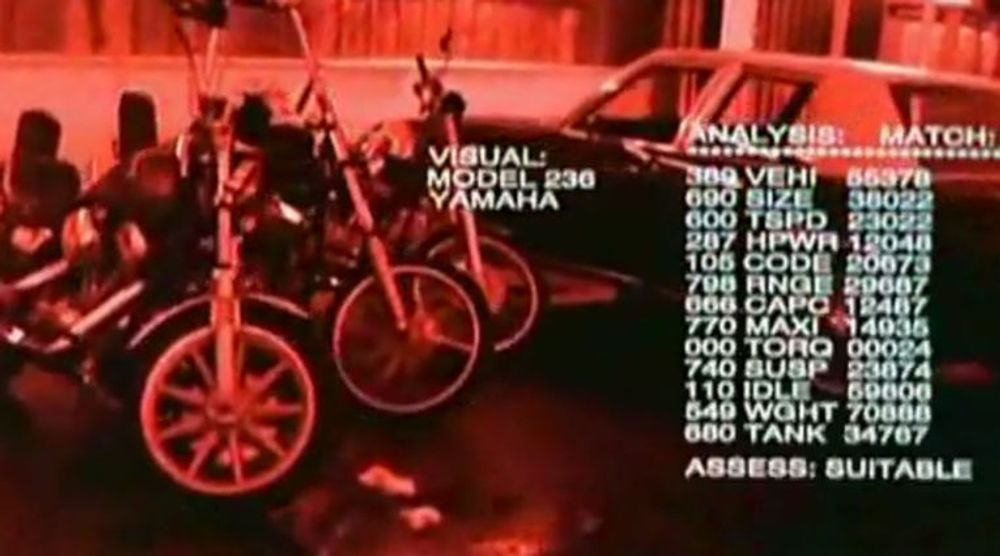

Instituttet er opptatt av å nedspille forestillingene om at de først og fremst skal motarbeide dommedag og maskinenes overtagelse av verden. De vil at science fiction skal forbli science fiction, og heller fokusere på konkrete problemstillinger rundt kunstig intelligens som eksisterer i dag og kan dukke opp i fremtiden. Det er i hovedsak snakk om å ta opp etiske spørsmål og sette klare regler for forskning innenfor feltet. Selv om FLI er takknemlige for at filmer som Terminator bidrar til å skape interesse for tematikken.

Elon Musk har riktignok uttrykt genuin bekymring for at kunstig intelligens kan bli farligere enn atomvåpen, men poenget er uansett å sette retningslinjer og begrensninger i dag, mens utviklingen av kunstig intelligens fortsatt er på et tidlig stadium.