Kunstig intelligens har vært et rimelig hett tema i 2017, og helt på tampen av året har vi funnet to ganske spennende saker som kanskje gir oss en pekepinn om den videre utviklingen innen feltet i 2018.

Forskere ansatt ved Google publiserte tidligere denne måneden en forskningsartikkel – som vi påpeker at ikke er fagfellevurdert – om tekst-til-tale-systemet de kaller for intet mindre enn Tacotron 2.

To nevrale nettverk genererer stemmer

Tittelen på forskningsartikkelen er «Natural TTS Synthesis by Conditioning WaveNet on Mel Spectrogram Predictions». TTS står for Text To Speech – tekst til tale.

«Mel Spectogram» benevner det første nevrale nettet det nye tekst-til-tale-systemet består av, som ifølge Quartz/qz.com oversetter tekst til et spektogram – altså en visuell representasjon lyd- eller signalfrekvenser.

- Les også: Dette er teknologien som driver Apples Siri, Google Translate – og spamfilteret ditt (Ekstra)

Spektogrammet mates ifølge Quartz/qz.com deretter inn i et annet nevralt nettverk kalt WaveNet, som kort fortalt leser spektogrammet og genererer lydklipp som tilsvarer spektogrammene.

Sluttresultatet kan du høre i ett av lydklippene lenger ned.

Forbrukere nesten like fornøyd med robotstemmer

Ifølge artikkelforfatterne oppnår modellen deres en såkalt Mean Opinon score på 4.53. Mean opinion score (MOS) brukes til å måle opplevelseskvalitet særlig i sammenheng med teknologi. Til sammenligning har profesjonelle stemmeopptak en på 4.58, ifølge forfatterne.

Se om du kan høre forskjellen på de to lydklippene under, hvor en kvinnestemme sier «That girl did a video about Star Wars lipstick».

I det ene av lydklippene er stemmen generert av kunstig intelligens som har satt sammen forskjellige ord fra en stemmeskuespiller. I det andre lydklippet hører vi en sammenhengende setning fremført av samme stemmeskuespiller i ett opptak (her i tilfeldig rekkefølge):

Google-forskerne har lagt ut flere eksempler på ekte stemmeopptak og kunstig genererte setninger med samme kvinnestemme på github.

Ny metode for kunstig intelligens-dialog

Osaka University melder at en forskergruppe bestående av deres egne forskere har utviklet en ny metode for dialogsystemer for læring hos kunstig intelligens.

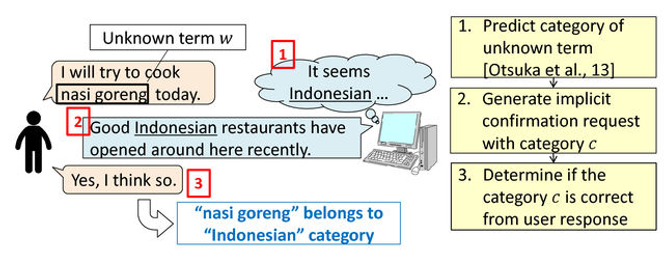

I et forsøk på å gjøre det mindre langtekkelig og kjedelig å lære opp kunstig intelligens i dialog med ekte mennesker – hvor man fort kan bli lei av at AI-en stiller spørsmål om omtrent alt man tar opp – prøver den kunstige intelligensen seg frem ved å pusle sammen forskjellige biter av informasjon.

Den kan bygge samtalen videre på antagelsene om at for eksempel matretten nasi goreng høres indonesisk ut, og derfor er indonesisk – og siden du sier at du skal spise nasi goreng, antar den at det er mat.

Men det den kunstige intelligensen ikke avslører, er at den i realiteten ikke er helt sikker på hva du mener. Forskernes nye metode går ut på at den kunstige intelligensen ikke stiller direkte spørsmål om hva du mener, men prøver å lære ved å føre samtalen videre – basert på antagelser.

Later som at den vet

I eksempelet fra Osaka University ville den for eksempel teste ut om den har rett ved å late som at den vet nøyaktig hva du mener med for eksempel nasi goreng, og bare svare «Det har åpnet mange bra indonesiske restauranter i området».

Om du da svarer at det var et godt tips, eller på en annen måte sier noe bekreftende, vil den kunstige intelligensen ut ifra konteksten lagre informasjonen om at nasi goreng vitterlig er en indonesisk matrett.

(Artikkelen fortsetter etter illustrasjonen.)

Osaka University påpeker i sin artikkel om saken at chatte-boter i dag snakker til alle på samme måte, og ikke tilpasser seg konteksten eller lærer av den.

Forskerne som har forsket frem denne nye dialogmetoden, mener at kunstig intelligens i fremtiden i langt større grad vil måtte kunne lære av selve dialogen og konteksten.

AI-er som bruker dette systemet vil med andre ord kunne lure deg trill rundt – ikke rent ulikt de gangene vi mennesker helst ikke vil avsløre egen uvitenhet om et samtaleemne.