Bøker fra en rekke norske forfattere er inkludert i KI-treningssettet Books3. Dette er brukt av Meta, Bloomberg og andre kommersielle aktørers store språkmodeller som trener opp generativ kunstig intelligens.

Nå reagerer flere norske forfattere på at deres verk, som skal stamme fra piratkopierte e-bøker, brukes til å utvikle kommersielle tjenester, skriver VG.

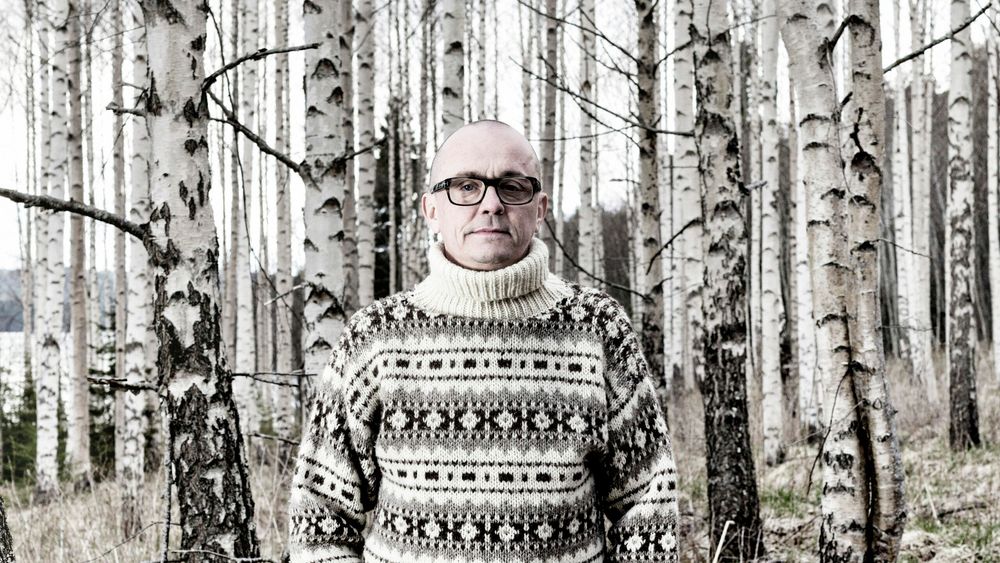

– Jeg synes det er skammelig at selskaper som vet bedre har som forretningsidé å knabbe åndsverk, sier Erling Kagge til VG.

Den norske forfatterforeningen har gått gjennom datasettet og funnet at minst 41 norske forfatteres bøker er med.

Fant sine karakterer i GPT

En av forfatterne har testet hva flere av de aktuelle GPT-tjenestene vet om romankarakterene sine.

– Jeg ba dem skrive et åpningskapittel om Mia Krüger og Holger Munch fra krimbøkene mine, og der kom alle karaktertrekkene fra mine bøker frem ned til minste detalj, forteller forfatter Frode Sander Øien til avisen.

Han mener at de kommersielle aktørene har tatt seg til rette og at det er forkastelig.

Erling Kagge sier til VG at han mener at selskaper som Meta har latt det gå sport i å bevege seg langs grensen av hva som er rett og galt.

Bygget på piratkopierte e-bøker

Books3 ble til etter at OpenAI slapp GPT-3 i juli 2020, skriver Wired. Maskinlæringsentusiasten Shawn Presser og andre interesserte ønsket å se om det var mulig å gjenskape GPT-3. Etter å ha studert GPT-3 kom de frem til at OpenAI må ha brukt en samling bøker fra et piratbibliotek.

Han gjorde i praksis det samme og bygget et bibliotek bestående av 196.000 bøker og kalte datasettet Books3 etter OpenAIs datasett med bøker kalt Books1 og Books2. Books3 ble gjort tilgjengelig på The-Eye.eu høsten 2020, et prosjekt som arkiverer og gjør data tilgjengelig.

Books3 ble deretter en del av et større datasett kalt Eleuther, som siden har blitt populær data å trene på – blant andre for Meta og Bloomberg.

Danske Rettighetdsalliancen jobber for å få fjernet Books3-datasettet fra nettet, etter at de oppdaget at minst 150 verk fra forfattere de representerer ligger i settet. De har blant annet fått Bloomberg til å love at de ikke skal bruke dette datasettet i fremtidige versjoner av sin BloombergGPT.